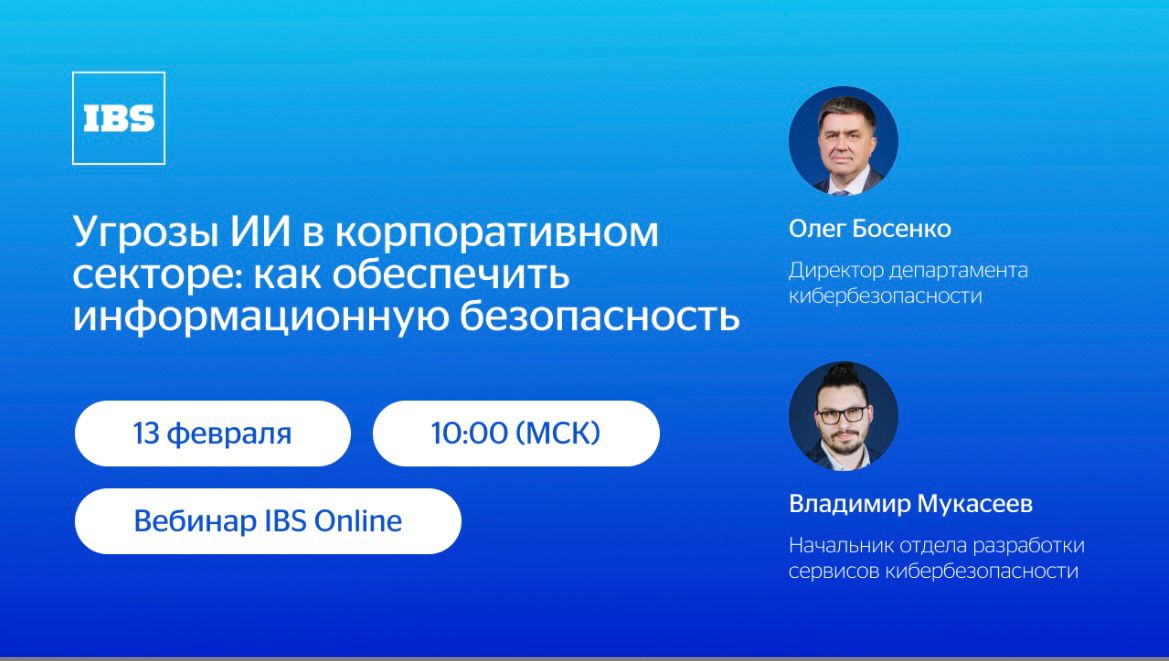

Внедрение технологий искусственного интеллекта (ИИ) стало одним из ключевых трендов современности, открывая новые возможности для бизнеса, государства и общества. Спикеры компании IBS рассмотрели основные тренды, меры государственной поддержки, риски и направления обеспечения безопасности при внедрении ИИ на корпоративном уровне.

Внедрение технологий искусственного интеллекта (ИИ) стало одним из ключевых трендов современности, открывая новые возможности для бизнеса, государства и общества. Спикеры компании IBS рассмотрели основные тренды, меры государственной поддержки, риски и направления обеспечения безопасности при внедрении ИИ на корпоративном уровне.

Ожидается, что к 2030 г. рынки, связанные с ИИ, значительно вырастут, охватив такие отрасли, как здравоохранение, транспорт, ритейл и промышленность. Например, рынок аналитики вырастет в четыре–пять раз, а рынок компьютерного зрения – в полтора–два раза в уже освоенных областях и более чем в десять раз в новых сферах, например, на транспорте и в здравоохранение. Рынок дополненной реальности (AR) увеличится в пять–11 раз, особенно в ритейле и туризме, а объем рынка цифровых двойников – в шесть–девять раз с акцентом на промышленности и здравоохранении. Эти технологии уже сегодня используются для персонализированных планов лечения, удаленного мониторинга здоровья, улучшения систем управления транспортом и оптимизации производственных процессов.

Государственная поддержка развития ИИ в России осуществляется в рамках Национальной стратегии развития ИИ до 2030 г., утвержденной Указом Президента РФ от 10 октября 2019 г. № 490. Основные направления стратегии включают развитие инфраструктуры и вычислительных мощностей: к 2030 г. планируется достичь экзафлопсного уровня производительности суперкомпьютеров, намечены разработка и продвижение отечественных открытых библиотек ИИ, создание репозиториев данных и решений в области ИИ. Также запущен проект «Экономика данных и цифровая трансформация государства», направленный на эффективное использование данных и оптимизацию производственных процессов. Важным элементом стратегии являются образовательные инициативы, такие как введение обязательного модуля «Системы искусственного интеллекта» в образовательные программы, что позволит подготовить специалистов, способных работать с современными технологиями ИИ.

Однако наряду с возможностями внедрение ИИ несет и новые вызовы, особенно в области информационной безопасности. Одной из ключевых проблем является прогрессирование кибератак, которые становятся более частыми и изощренными. Деструктивные элементы активно используют технологии ИИ в своих целях, что значительно сокращает ресурсы, необходимые для реализации неправомерных действий. Например, исследование компании IBS показало, что количество моделей машинного обучения (ML), применяемых в даркнете, превосходит количество моделей, используемых в легальных целях, в три раза. Основные риски включают повреждение или уничтожение баз данных и моделей ML вследствие взлома механизмов ИИ, повышение информированности нарушителей за счет оперативного доступа к большим объемам информации о кибератаках, расширение возможностей внутреннего нарушителя в несанкционированном доступе к информации, а также появление новых классов атак на имидж.

Для обеспечения безопасности при внедрении ИИ на корпоративном уровне необходимо учитывать несколько ключевых направлений. Во-первых, аудит активов на наличие актуальных угроз, связанных с ИИ. Этот процесс начинается с обследования инфраструктуры с целью выявления уязвимостей и определения критических информационных активов, которые требуют особого внимания. Затем проводится детальный анализ критичных активов и процессов, что позволяет выявить потенциальные угрозы и сформировать отчет с рекомендациями по устранению рисков и усилению защиты. Во-вторых, важна защита от типовых атак с применением ИИ, что требует разработки и внедрения специализированных мер. В-третьих, необходимо уделять внимание защите ML, баз данных и разработки ПО. Машинное обучение, являясь ключевым направлением ИИ, сопряжено с рисками, такими как data poisoning, утечка информации и недостаточная масштабируемость. Для минимизации данных рисков Владимир Мукасеев, начальник отдела разработки сервисов кибербезопасности, предлагает использовать ML SecOps, основной целью которого являются предотвращение атак на данные и модели, а также обеспечение соответствия нормативным требованиям. Для минимизации рисков используются различные методы, в частности, управление безопасностью данных через применение специализированного оборудования и реализацию Differential Privacy с целью снижения рисков утечек, постоянный мониторинг и аудит инфраструктуры для выявления угроз, защита моделей с помощью методов, повышающих их устойчивость к атакам, контроль версий данных и моделей с использованием инструментов типа DVC или Milvus. Кроме того, для обеспечения доступности и безопасности развертывания применяются распределенные системы хранения и автоматизация CI/CD-конвейеров, что позволяет минимизировать риски на каждом этапе разработки и эксплуатации ML-решений.

Особое внимание следует уделить защите от дипфейков, которые становятся все более распространенной угрозой. Для этого предлагаются разработка методологического обеспечения с целью контроля и защиты от киберинцидентов, внедрение автоматизированных решений для защиты внутреннего контура организации и создание комплекса мер для предотвращения киберинцидентов с применением технологии DeepFake. Важными элементами защиты являются аудит потенциальных каналов проникновения DeepFake, разработка технологических решений для внутренних каналов коммуникаций и постоянное усиление мер по обеспечению защиты от мошенничества.

Искусственный интеллект – это не просто технология будущего, а реальность, которая уже меняет наше информационное пространство, подходы к работе с данными, процессы обучения и производства. Однако для успешного внедрения ИИ необходимо уделять особое внимание вопросам безопасности. «Не стоит рассматривать ИИ как что-то выдающееся, способное обогнать человеческий интеллект. У него нет человеческого чувства, ИИ никогда не сможет полюбить так как полюбит человек, но присутствовать в нашей жизни он будет очень долго. Он изменит наше информационное пространство, наши подходы по работе с информацией, наши процессы обучения, технологии производства. Это та данность, в которой мы будем жить и которая требует обеспечения защиты и безопасности», – отметил Олег Босенко, директор департамента кибербезопасности.

Искусственный интеллект – это не просто технология будущего, а реальность, которая уже меняет наше информационное пространство, подходы к работе с данными, процессы обучения и производства. Однако для успешного внедрения ИИ необходимо уделять особое внимание вопросам безопасности. «Не стоит рассматривать ИИ как что-то выдающееся, способное обогнать человеческий интеллект. У него нет человеческого чувства, ИИ никогда не сможет полюбить так как полюбит человек, но присутствовать в нашей жизни он будет очень долго. Он изменит наше информационное пространство, наши подходы по работе с информацией, наши процессы обучения, технологии производства. Это та данность, в которой мы будем жить и которая требует обеспечения защиты и безопасности», – отметил Олег Босенко, директор департамента кибербезопасности.